ドラえもんに登場する「ほんやくコンニャク」。食べるだけで、自分が話す言語は相手が話す言語に自動翻訳され、言語の壁を超えて誰とでも自由に会話できるという夢のような道具だが。

そんな「ほんやくコンニャク」にもなかった高機能を搭載したツールが、昨年、現実世界で誕生していた。未来の職人ではなく“大学生”が開発した、ひみつ道具ではなく“スマホ用アプリ”は、手話をリアルタイムで翻訳し、音声言語と手話間での会話を可能にしてくれるというのだ。

相手のスマホに“手話で話す自分”がうつる?

近年、機械翻訳は進化を遂げている。性能はみるみる向上し大体の言語は翻訳され、違う言語を話す人々とのコミュニケーションもだいぶ取りやすくなった。自分の言語で話しかけると、指定の言語に翻訳しテキスト化してくれる「グーグル翻訳アプリ」や、日本語を吹き込むだけで、外国語の音声に変換してくれる音声翻訳機「イリー」などのおかげだ。着実に進歩しつづける翻訳機能を横目に、見過ごされがちな言語が手話だった。手話は万国共通ではなく、言語同様に国によって異なる。現在世界で使われている手話は138から300種類あるといわれており、くわえて新しい手話も日々誕生。複雑な手の動きだけでなく顔の表情も要であるという手話、確かに翻訳は容易ではない…。

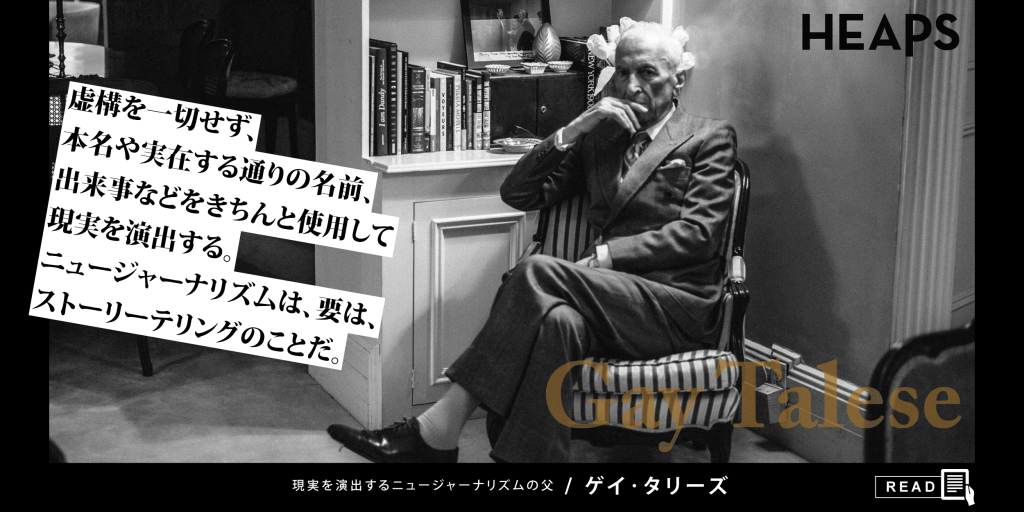

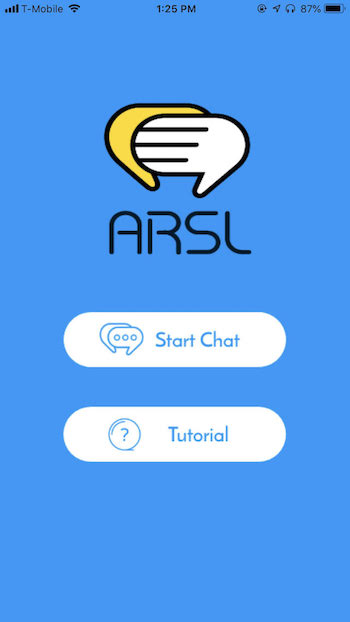

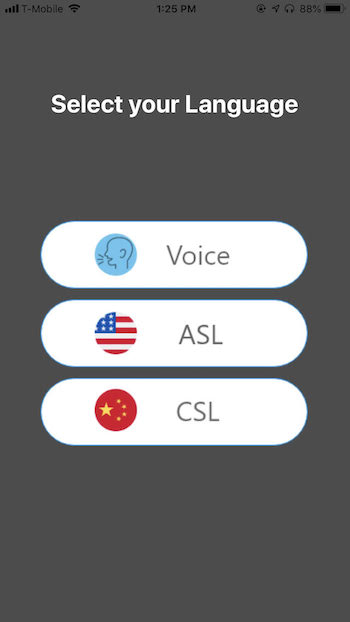

その流れの中で、今回ニューヨーク大学タンドン工科校の学生3人組が在学中に発表したのが、AR(拡張現実)技術を駆使して手話をリアルタイムで翻訳するアプリ「ARSL」。拡張現実とは、現実世界で人が感知できる物事に別の情報を加えて現実を拡張表現する技術や手法のことで、ポケモンGOが好例だ。プロジェクトリーダーのツォンヘンが耳の聞こえない両親をもつ友人に影響を受け、大学仲間2人とともに始動。米通信大手「ベライゾン」とテクノロジーの革新を掲げる「ニューヨーク市メディアラボ」が提携し大学生の製品開発を支援する「コネクテッド・フューチャー・チャレンジ」の一環として、アプリを開発した。手話で話す人と、手話が話せない人同士のコミュニケーションを円滑にしてくれるという、ほんやくコンニャクでも実現できなかった機能をみてみよう(実際の使用方法はコチラの動画から)。

2、ユーザーA(音声言語)は、アプリに向かって話す。アプリは音声を読み取り、手話に翻訳。ニューザーB(手話)のアプリ画面には、リタルタイムで手話を話すAの姿(バーチャル)が表示される。このバーチャルのユーザーAが拡張現実ということになる。

3、ユーザーBは、画面上のAの手話を見て、話の内容を確認。ユーザーAのスマホに向かって手話で返答。アプリは、その手話の動きを認識し即座にテキストに翻訳。ユーザーAのアプリ画面に、テキストでリアルタイムで表示される。

自分の話した言葉を手話に翻訳、相手の手話を文字に翻訳。アプリを通して、手話ができなくても手話での会話を可能にしてくれるという仕組みだ。

これまでにも、手話を通訳・翻訳するツールはあった。ワシントン大学の学生が開発した手袋「サインアラウド」(手袋に埋め込まれたセンサーが手の動きを読み取り翻訳し、Bluetooth経由でパソコンから音声で流せる)や、NTTデータとシャープが共同開発した、コミュニケーションロボット「ロボホン」が手話を認識できるアプリ(手の動きを認識し翻訳し音声化・テキスト化、また音声を認識しテキスト化)。それに、手話のGIFアニメをメッセージとして送信できるアプリ「ファイブアップ」などなど。

何より“手話を話すバーチャルな自分”が出現するのも新しいし、特別な道具は必要とせず、自分のスマホにアプリを入れるだけのARSLは、会話としてより身近だ。スマホをかざすだけで「手話の動き⇄音声・テキスト」という双方向からのインタラクティブな会話をリアルタイムで可能になる。

現在はプロトタイプの状態のARSL。現段階では限られたフレーズしか対応しておらず、製品化はまだ決まっていないものの「製品化を目指し、将来は通訳のいない小さな診療所でも手話話者が1人で予約をできるような環境を実現したい」。

ツォンヘンは「手話には制限がある」という。以前ヒープスで取材した聴覚を持たず四感で音を創り出すアーティストのクリスティーンも、「平等に扱ってもらうため、自分の声を代弁してくれる手話通訳士と働く必要があった」と言っていたっけ。将来、手話通訳士いらずのアプリが製品化されれば、コミュニケーションが必須とされることの多い生活の中で、手話話者が感じる制限も薄れていくはず。ドラえもんもうらやんで、“手話も話せるほんやくコンニャク”を新しい味で登場させるかもしれない。

—————

All images via Zhongheng Li

Text by Yu Takamichi

Content Direction & Edit: HEAPS Magazine