「Hey Siri!(ヘイ、シリ!)」「What can I help you with?(いかがいたしましょうか?)」でおなじみの、AI音声アシスタント。アップルのシリに、アマゾンが開発したアレクサ、グーグルが開発したグーグルホーム。人間の呼びかけや要求に反応し、生活をアシストしているAI音声アシスタントに対し、あるコトが指摘されている。

「AIアシスタントのデフォルトの声は『女性』。これじゃあ、ジェンダーバイアスを助長しませんか?」。これを解消すべく考案されているのが“フェミニスト・アレクサ”。ジェンダーレスな声を持つ。

AIの世界にも持ち込まれる「ジェンダー問題」

「AI音声アシスタントは、性差別を助長している」。今年、UNESCO(国際連合教育科学文化機関)が発表した報告書にそうあった。「今日の天気は?」「タイマーセットして」など人間の命令に快く応えてくれるシリ、アレクサ、グーグルホームなどの大衆製品に、デフォルトで登録されているのが「女性の声」だ。これがジェンダーバイアスを強化している、と主張した。

AIのジェンダーバイアス問題を指摘する声は年々増加していて、「要求に応えるのが女性の役割だというステレオタイプを反映しているツール」と批判する声や、試しにセクハラ発言を投げかけたら、健気に答えてくれたという実体験も聞こえてくる(「魅力的だね」「お前は尻軽女だ」という人間の言葉に、AIは「ありがとう」「そんな、恥ずかしくて顔が赤くなります。実際にはなれないけど」と恐縮したり、「まあまあ」と軽くたしなめるだけ)。ちなみに、IT大手「IBM(アイ・ビー・エム)」が開発した人工知能「ワトソン」には男性的な声が採用されている。ワトソン君がおこなうのは、ビジネスや医療、金融、人材サービス、クイズショーなど専門性が高い分野や高度なスキルが求められる仕事だ。アレクサちゃんが対応する「カレンダーを見せて」ではない。

AIに持ちこまれるジェンダー問題をうけて、「AIのジェンダーフリー」に向けてさまざまな団体や企業が動きはじめている。ビジネスやテクノロジー、教育機関などの専門家を集め、ジェンダーに平等なAIをつくろうとガイドラインを作成する団体などもあるなか、興味深いのは「ジェンダーレスAI」を開発しようという動きだ。今年の初めには、デンマークのクリエイティブスタジオ「Virtue Nordic(バーチュー・ノーディック)」が世界初のジェンダーレスAI音声「Q(キュー)」を開発し、話題に。約4,600人のノンバイナリージェンダー*から集めた声のサンプルを融合させることで“男性でも女性でもない”ジェンダーニュートラルな声を作りだした。声の高さは約153ヘルツ、やわらかくやさしげな声色。思ったよりも低めだなと感じるのは、女性AIアシスタントの高めの声に耳が慣れているからだろうか?

*女性、もしくは男性どちらにも分類されないジェンダー。

ジェンダーレス音声は、罵倒すると「礼儀正しくしろ」etc

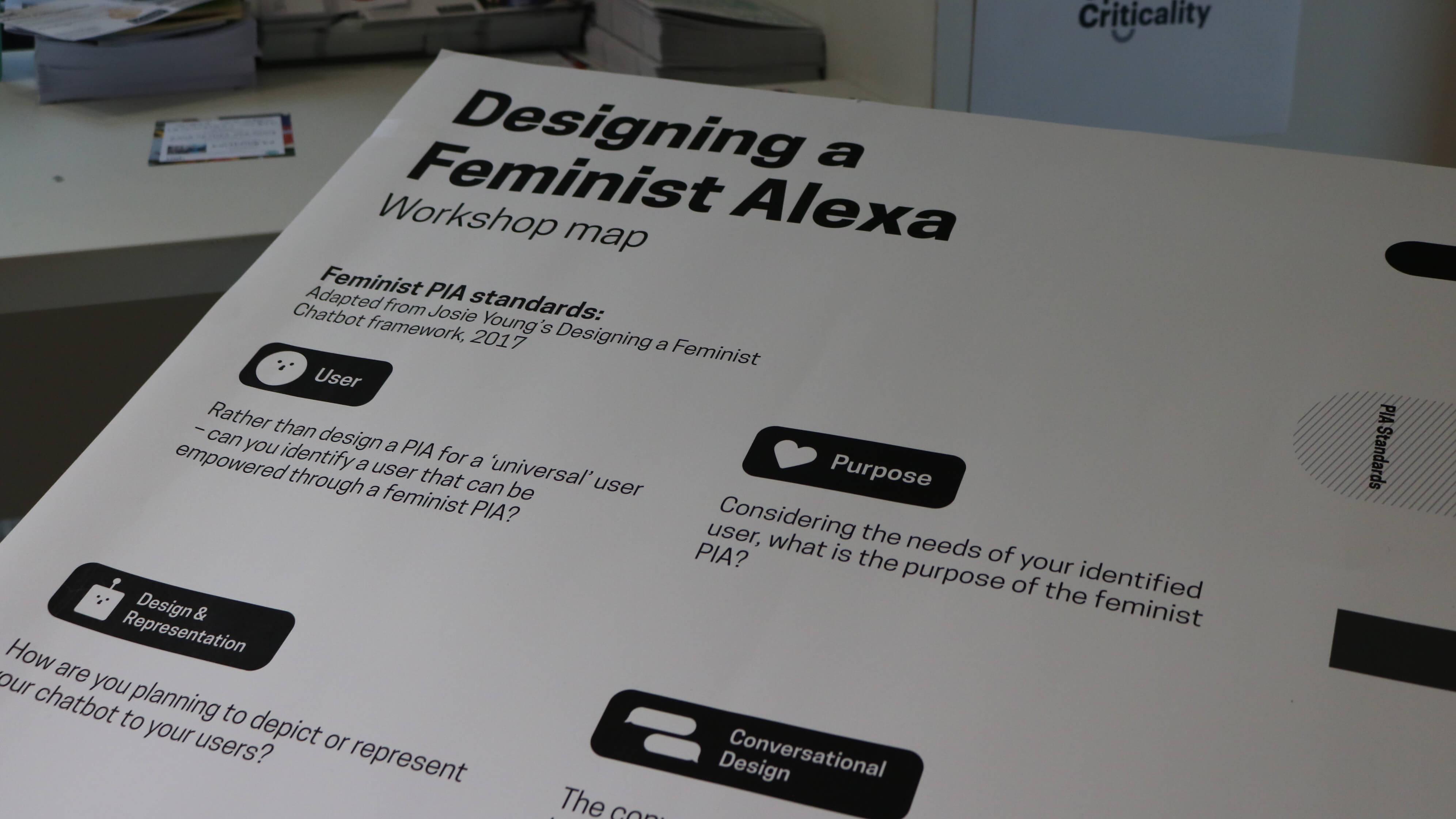

ジェンダーレスAIの開発は、続々と遂行中だ。「インターネットをもっと平等なスペースに」をモットーとする英非営利団体「Feminist Internet(フェミニスト・インターネット)」は、ジェンダーフリーなAI音声アシスタント「フェミニスト・アレクサ」をデザインしている。同団体は、昨年にはロンドン芸術大学の情報学部と提携し、ワークショップを実施。同学部の生徒40人と8つのプロトタイプを考案した。

たとえば“タブーな質問に答えてくれる”AI音声アシスタント「B(O)(O)(ブー)」。思春期に抱えるジェンダーやセクシュアリティのタブーな悩みをなんでも打ち明けられるよう、ティーン向けに開発された。「わき毛が生えてきたんだけど…これっておかしいの?」と問いかけると、「全然おかしくないよ、人と比べないで」という答えが、ジェンダーレスの声で返ってくる。「お前、クソだな!」と罵倒すると「もっと礼儀正しくしてください。私は人間ではないですが、暴言はどんな形でも許されません」と、真面目にお説教してくれるプロトタイプも生まれた。

解決に向け、動きはじめたばかりの「AIのジェンダーバイアス問題」。ユネスコのサニエ・ギルセル・コラット男女共同参画局長は、「AI技術の性別がどのように決められるのか。そして誰がそれを決めているのかにもっと注意を払うべき」と訴えている。AI=ロボットといえど、それを生み出しているのは人間。つまり、AIのジェンダー問題は、AIをつくる人間が抱えてきたバイアスを無意識にそのまま映し出しているということだ。AIを作る側にいる女性の数は圧倒的に少なく、フェイスブック社では女性AI研究スタッフは15パーセント、グーグル社では10パーセント。AI関連のカンファレンスに参加するAIプログラム製作者のうち、女性はたった18パーセントだ。トランスジェンダーやセクシャルマイノリティの数に関しては、公開すらされていない。

2020年には、スマホにおけるネット検索のうち、その半数が音声アシスタントによっておこなわれると予測されている。日常的に耳にする女性のAIボイスを通して、ジェンダーバイアスが無意識のうちに植えつけられてしまう前に。まずは冷静に、AIにこんなふうに問いかけるべきかもしれない。「ねえSiri、なんであなたの声は女性の声なの?」

—————

Eyecatch image by Midori Hongo

All Photos by Feminist Internet

Text by Haruka Shibata

Content Direction & Edit: HEAPS Magazine